Medienkritik

KI-Slop zwischen Rollenspiel und Fan Fiction. Interview mit Jacob Birken

25.02.2026

Hinweis: Dieser Artikel enthält externe Links. Sie sind durch das Symbol 🔗 gekennzeichnet. Bei Anklicken externer Links wird Ihre IP-Adresse u.U. in Staaten außerhalb der EU übertragen. Klicken Sie externe Links nur an, wenn Sie mit so einer Übertragung einverstanden sind.

Es vergeht gerade kein Tag, an dem nicht neue Absonderlichkeiten aus der 'KI'-Welt auf Betracher*innen einströmen. Je nach Einstellung und dem Willen zu kritischer Reflexion mögen sie faszinieren, abstoßen oder einfach nur den Kopf schütteln lassen. Insbesondere bildliche Darstellungen provozieren zur schnellen Reaktion.

Ob in der Werbung (wie im Spot zu 100 Jahren Persil) oder in etablierten Nachrichtenmedien (wie zuletzt der KI-generierte Clip im heute journal); ob in sich seriös gebenden Kunst- und Geschichtsprojekten (wie bei "Versäumte Bilder" von Gesine Born, 🔗 das historisch bedeutsame Frauen durch fiktive, 'KI'-generierte Bilder darstellt und so ihre tatsächliche Existenz erst in den Hintergrund rückt) oder im politischen Raum (wie die manipulierten Bilder, die die US-Regierung von der 🔗 verhafteten Anwältin Nekima Levy Armstrong erstellte) – wir können solchen Bildern kaum entgehen.

Aber was sehen wir eigentlich, wenn wir 'KI'-Bilder betrachten und welche Funktion erfüllen sie? Ist das alles matschiger AI Slop? Und was ist eigentlich mit scheinbar autonomen 'KI'-Bots, von denen gerade berichtet wird, sie würden ihr eigenes Ding machen? Der Kulturhistoriker Jacob Birken teilte mir dazu im E-Mail- und Bluesky-Interview einige erhellende Einsichten mit.

KI-Slop

MD: Jacob, auf 🔗 deiner Website schreibst du über dich: "Meine Arbeit hat meistens damit zu tun, welche Bilder sich Menschen von Geschichte machen, aber auch damit, wie Bildermachen historisch eingeordnet wird." Aus dieser Kompetenz heraus bist du auch Beobachter des gegenwärtigen Umgangs mit Bildern und Geschichte(n). Eine besondere Rolle für diesen Umgang spielen im Moment Bilder, die unter Beteiligung sogenannter generativer 'KI' erzeugt wurden.

Gibt es zwischen den vielen Arten, Verwendungsweisen und Kontexten von 'KI'-Bildern einen qualitativen und funktionalen Unterschied, oder kann man das alles als "AI Slop" bezeichnen und auf dieselbe Weise kritisieren bzw. 'verdammen'?

JB: Theoretisch würde ich gerne differenzieren: Es sind ja sehr unterschiedliche Anliegen, ob jemand ein böswilliges Deepfake einer anderen Person, einen visuellen Gag wie den Papst im Daunenmantel oder – aus vielleicht sentimentalen oder didaktischen Gründen – ein 'fehlendes' Bild von etwas oder jemandem durch KI erzeugen lässt. Auch in der Fotografie ist es möglich, Bilder zu manipulieren oder zu inszenieren, aber das hat ihren Status als privilegierte Darstellungsweise der materiellen Wirklichkeit nie ganz ausgehebelt – zum einen ist es eine über Generationen hinweg eingeübte Konvention, Fotos als Aufzeichnung und beweiskräftiges Dokument zu verwenden, zum anderen stellten bereits die Kontexte, in denen wir Fotos zu sehen bekamen, für lange Zeit klar, auf welche Weise wir ihnen einen Wirklichkeitsbezug zuschreiben sollen.

Wer in einer Kunstausstellung inszenierte Fotos von 🔗 Jeff Wall oder 🔗 Cindy Sherman betrachtet, wird deren Funktion nicht mit einer Nachrichtenfotografie verwechseln, wie auch jemand im Kino einen Hollywood-Blockbuster nicht als Liveübertragung anschauen wird. Aktuell ist aber der Kontext für wahrscheinlich die meisten produzierten und gesehenen Bilder das Internet samt seiner Aufmerksamkeitsökonomien. Das heißt, dass sich jedes Bild zuallererst gegenüber den anderen Bildern auf einer Timeline durchsetzen muss, bevor wir überhaupt anfangen, über seine Produktions- und Rezeptionszusammenhänge nachzudenken.

MD: Welche Bilder setzen sich derzeit am ehesten durch? Sind das die 'KI'-generierten?

JB: Bestimmte 'internettaugliche' Bildformeln wie Memes oder Selfies haben sich schon lange vor generativer KI herausgebildet, aber letztere scheint sich vielleicht allzu gut dem heutigen Internet – dem der Social-Media-Plattformen – anzudienen. Max Read hat vor ein paar Monaten 🔗 'slop' als etwas definiert, das für seine jeweilige Domäne derart optimiert ist, dass es jeden Charakter, jede Textur verliert. Das passt tatsächlich gut zu KI-generierten Medien im Internet; sie sind eben dafür optimiert, sich nahtlos in den Prozess des Likens, Teilens, Weiterscrollens einzufügen und diesen noch effizienter anzutreiben – alleine schon dadurch, dass generative KI massenhaft und passgenau für bestimmte Plattformen und Publika produzieren kann. Und ich würde sagen, dass diese für Social Media typische Praxis eines oberflächlichen, flüchtigen Schauens sich erstaunlich gut auf das meiste an KI-generierten Medien übertragen lässt, selbst wenn diese nicht für’s Internet gedacht sind.

KI-Slop scheint eine Erwartungshaltung daran mitzubringen, wohlwollend abgenickt zu werden – das ist ja auffällig oft wirklich fahrlässig gemacht, als hätten selbst die Produzent*innen es keines zweiten Blicks für wert gehalten. In diesen letztens erschienenen Videos zur amerikanischen Revolution von Darren Aronofsky für das TIME Magazine gibt es zum Beispiel eine Szene, wo auf einem Dokument statt "America" groß etwas wie 🔗 "AAMEREEDD" steht. Das muss doch jemand gesehen und entschieden haben, das ist okay, das können wir so zeigen. Die einzige Erklärung, die ich dafür habe, ist, dass das Teil des Anspruchs einer aktuellen digitalen Bildproduktion ist: Wir sollen uns diesen Slop anschauen und glauben, dass das richtig toll und sogar besser sei als ein konventionell gemachter Film.

Um also auf deine Ausgangsfrage nach den funktionalen Unterschieden solcher Bilder zurückzukommen: Einerseits gibt es diese sicherlich, Darren Aronofsky will – so sehr er daran scheitert – mit diesen Bildern immer noch eine cineastische Geschichte der US-Revolution erzählen, was etwas ganz anderes ist, als wenn die US-Regierung ein manipuliertes Foto der bei einem Protest festgenommenen Anwältin Nekima Levy Armstrong veröffentlicht, auf dem diese wie eine Person auf dem früheren, wiederum per KI 'ghiblifizierten' Bild einer 🔗 ganz anderen Festnahme als weinend gezeigt wird.

Andererseits schwingt in beiden Fällen eine weitere, gemeinsame Funktion mit: Wir sollen uns daran gewöhnen, dass heute in Bezug auf Bilder alles möglich sei. Im Fall von Aronofskys Videos ist das noch ein ganz naives Fortschrittsversprechen – schaut, was die Software alles kann, was wir alle dank dieser Software machen werden können, wenn wir nur weiterhin der Techindustrie eine halbe Welt an Ressourcen in den Rachen schmeißen. Dass das sogar schon auf den ersten Blick ziemlicher Murks ist, sollen wir vorerst hinnehmen, wie wir schließlich auch schon an Nylonfäden baumelnde Raumschiffe im vordigitalen Film hingenommen haben oder uns selbst einredeten, wie unglaublich 'realistisch' doch die krude 3D-Grafik von Games in den 1990ern sei.

MD: Aber bei den für politische Zwecke verbreiteten 'KI'-Bildern geht es ja um mehr als das Hinnehmen ihrer technischen Unzulänglichkeiten. Vielleicht ist ein Ziel auch, dass wir hinnehmen, dass politische Akteure (z.B. die US-Regierung) das Vertrauen in den Wirklichkeitsbezug von Bildern grundsätzlich erodieren lassen. Klar wurden schon immer Fotos manipuliert, und es gab auch immer ein Bewusstsein für die Existenz von Propaganda, aber in der Masse sprach man Fotos doch Glaubwürdigkeit zu. Das ändert sich gerade, oder?

JB: Im Fall der durch die US-Regierung verbreiteten KI-Bilder wird der eben von mir beschriebene mediale Möglichkeitsraum noch an einen konkreten Herrschaftsapparat gekoppelt. Diese Bilder sollen vermitteln, dass spezifisch für die US-Regierung alles möglich sei, sowohl auf materieller wie auf darstellender Ebene. Damit verändert sich die zunehmend die Funktion von Medien – auch etwas, das wir auf den ersten Blick als Fotografie, also als Aufzeichnung der materiellen Realität erkennen, dient nur der Illustration bestimmter Machtverhältnisse. Kritik an der Manipulation des Gesichtsausdrucks von Levy Armstrong kommentierte die US-Regierung nur mit "Enforcement of the law will continue. The memes will continue". Wer sich hier noch darüber aufregt, dass die US-Regierung die Wirklichkeit verfälsche, übersieht, dass das genau der Punkt ist – es geht zum einen um die Vermittlung der 'Wirklichkeit' als dem, was sich der autoritäre Staatsapparat darunter vorstellt, und zum anderen darum, das Realitätsverhältnis der Kontrahent*innen dieses Machtapparates zu sabotieren, indem unser Vertrauen in die Bilder zertrümmert wird. Das war ja schon bei dem 'ghiblifizierten' Festnahme-Bild so, dass hier ein Stil angeeignet wurde, den eher Linke und Liberale als gut, wertvoll, wholesome einordnen.

Roland Meyer nannte das alles 🔗 "Bildwelten der Rücksichtslosigkeit", und ich glaube, dass das aktuell auch auf die gut gemeinten Projekte überschwappt, die generative KI einsetzen. So lange solche Projekte – ich denke da wieder an Aronofskys Revolutions-Clips oder Gesine Borns 🔗 Ausstellung zu 'versäumten' und per KI nachgelieferten Bildern historischer Wissenschaftlerinnen – auf ein oberflächliches Sehen bauen, so lange sie nur auf den Hype setzen, dass jetzt dank KI alles möglich sei, ohne die Ergebnisse anhand der Qualitätskriterien zu prüfen, die wir sonst an Medien anlegen – so lange würde ich auch von 'gut gemeinten' Projekten als KI-Slop sprechen wollen. Sie sind vielleicht nicht bewusst rücksichtslos wie die 'Slopaganda' der US-Regierung, aber letztlich fahrlässig, was einen angemessenen Umgang mit Repräsentation, mit Medien insgesamt angeht.

Rollenspiel und Fiktion

MD: Ich muss bei den aktuellen Nutzungsweisen von Bildern und Texten auch an permanentes Rollenspiel denken. Nicht nur bei großen Medienereignissen (wenn sich etwa der ICE-Kommandant Gregory Bovino in einer Fantasieuniform mit nazireskem Wintermantel darstellt, oder der ganze Trump-Propaganda-Slop). Und auch nicht nur bei unserer eigenen Inszenierung in gefilterten Selfies oder mit gestellt-spontanen Fotos auf Social Media. Sondern vor allem in ganz gewöhnlichen Alltagssituationen.

Wenn z.B. die (nicht-KI-generierten) automatischen Bahnhofsdurchsagen "meine Damen und Herren" sagen, oder "ich bitte um Aufmerksamkeit", dann wirkt das recht spielähnlich auf mich. Denn das ist ja keine Person, auf die das "ich" und das "meine" der Ansagen verweisen. Die Stimme ist eher wie ein NPC. Dasselbe haben wir nun verschärft bei Chatbots, die Personalpronomen, Selbstaussagen und Emojis verwenden. Der Bot generiert Text, der die Illusion erzeugt, der Bot wäre eine Person. Wenn wir den Bot auch mit "du" anreden, dann ratifizieren wir die Illusion.

So sind wir mittendrin im Spiel, selbst wenn das Thema des Spiels banalste Arbeitsaufgaben sind. Denn auch das Generierenlassen von Bildern oder das Zusammenfassenlassen von Texten ist in gewisser Weise Rollenspiel: Menschen tun mittels dieser Tools so, als wären sie plötzlich Künstler*innen oder als wären sie über einen Diskurs informiert, und der Bot bestärkt sie noch in dieser Ansicht. Also ständiges so tun, als ob, auf allen Ebenen, Rollenspiel eben. Oder schildere ich das gerade alles schlimmer als es ist?

JB: Ich nehme an, dass es vielen von uns so geht! Zuallererst würde ich wieder sagen, dass dieser Vertrauensverlust zu einem Teil gewollt ist, wenn eben Akteur*innen wie die Trump-Regierung KI als Machtinstrument gebrauchen. Grundsätzlich ist Manipulation von und mit Bildern nichts Neues, wie vorhin schon erwähnt; denken wir an das gut bekannte Beispiel von Stalin, der sukzessive ehemalige Mitstreiter aus Fotografien rausretouchieren ließ. Allerdings dient sich generative KI erneut allzu gut solchen Zwecken an, da sie von ihrer Funktionsweise immer spekulativ ist, immer ein Prozess, durch den aus bestehenden Daten etwas nicht Existentes und zugleich möglichst Überzeugendes synthetisiert wird. Das kann auf mehreren Ebenen ein 'Als ob', ein 'Was wäre wenn' sein.

Nehmen wir wieder Gesine Borns Frauenbilder. Diese sollen inhaltlich eine Spekulation sein: Was wäre, wenn bestimmte historische Persönlichkeiten in Situationen fotografiert worden wären, die ihnen aufgrund ihres Geschlechts verweigert wurden? Zugleich sollen wir diese Bilder aufgrund bestimmter formaler Eigenschaften betrachten, als ob es Fotografien wären. Auf rein konzeptioneller Ebene bleibt das spielerisch, nicht anders vielleicht, als wenn sich eine Künstler*in à la Cindy Sherman verkleidet hätte, um eine bestimmte Situation nachzustellen und damit spezifische Klischees zu parodieren. Nur wird diese Art des ‚spekulativen‘ Bildermachens jetzt zu einer allgemein verfügbaren, industriellen Produktion skaliert, womit sich auch ändern könnte, wozu Bilder da sind.

MD: Und (nochmal in Bezug auf das vorhin Gesagte) werden wir uns einfach daran gewöhnen und z.B. bald einfach gar nicht mehr davon ausgehen, dass überhaupt irgendetwas, das wir medial wahrnehmen, einen Wahrheitsanspruch hat?

JB: Mir fällt es noch schwer, die tatsächlichen Konsequenzen dieser Entwicklungen abzuschätzen. Wenn Stalin nicht an die Qualität der Fotografie als empirisches Dokument geglaubt hätte, hätte er die Bilder nicht manipuliert, und ich vermute, dass es den Internettrollen im Weißen Haus noch ähnlich geht – das könnte auf einen paradoxen, letztlich wohl pathologischen Zustand hinauslaufen, in dem die Konvention von Medien als Aufzeichnungen der 'Wirklichkeit' nur so weit erhalten bliebe, um die Überzeugungskraft fotorealistischer Fakes zu stützen.

Mir scheint es da auch Bestrebungen einer Art szientistischer Esoterik zu geben, KI einen privilegierten Zugang zur Wirklichkeit zuzuschreiben – weil der Computer doch sonstwie objektiv sei oder dank des Gesetzes der großen Zahlen unausweichlich die gesamte Welt korrekt abbilden wird können, wenn sie denn endlich datengerecht aufgearbeitet sei; und schließlich kann die Techbranche auf Phänomenebene durchaus passende Ergebnisse zu solchen Ideologien liefern, zumindest, was immer weiter perfektionierte Illusionen angeht. Dann kommen wir vielleicht ernsthaft in der Matrix an, in miteinander konkurrierenden ‚Wirklichkeiten‘, von denen die eine diejenige der digitalen Illusion ist und die andere diejenige der zur reinen Ressource reduzierten Biomasse.

MD: Das klingt jetzt sehr nach Science Fiction… wird die gerade Wirklichkeit?

JB: Etwas weniger Sci-Fi: Der Evidenzcharakter von Medien könnte verallgemeinert werden, Bilder generell zu Illustrationen von dem werden, woran man glaubt. Fotorealismus gäbe dem allenfalls noch den letzten Schliff, aber vielleicht erübrigt sich das, sobald sich die 'Wahrheit' eines Bilds ohnehin daran entscheidet, ob darauf das zu sehen ist, was wir als ideologisch 'wahr' erachten. Das würde wiederum das privilegierte Verhältnis der Fotografie zur materiellen Wirklichkeit aufheben, und die Frage wäre, ob damit auch die gesellschaftliche Rolle der Medien zurückgesetzt werden würde.

Ich bin kein großer Freund der traditionellen Erzählung über die Kunst, die angeblich im Zuge der Aufklärung von ihrer Indienstnahme zur herrschaftlichen Repräsentation 'befreit' wurde – sicherlich werden heute verhältnismäßig weniger Bilder von Monarch*innen und Päpsten produziert, aber das heißt nicht, dass aktuelle Bilder nicht Ausdrucksmittel jeweiliger Herrschaftssysteme seien. Es ist dennoch kaum ein Zufall, dass die Fotografie als Mittel empirischer Aufzeichnung in eine Epoche fällt, in der Empirie als Teil des größeren Projekts der sogenannten Aufklärung zur Entwicklung ganz neuer Herrschaftsformen führte.

Was bedeutet es also, wenn mit generativer KI die spekulative Illustration zum neuen medialen Paradigma wird? Treten wir vielleicht gerade in eine Phase ein, in der alle mit Hilfe vernetzter digitaler Medien ihren jeweiligen herrschaftlichen Anspruch auf die Wirklichkeit LARPen, bis jemand nachhaltig die eigenen Spielregeln auch für alle anderen durchsetzen kann?

Du hast 2020 in einem 🔗 Artikel über Fotografien in Nachrichtenmedien daran erinnert, dass "'Glaubwürdigkeit' hier weniger eine 'indexikalische' Übereinstimmung zwischen Bild und Abgebildetem [bedeutet], sondern vielmehr die Integrität der Erzählung" und dass "die Photographie hier keine Evidenz [erzeugt], sondern Emotion [vermittelt]". Das hat sich mit 'KI'-Bildern doch jetzt ins Extrem gesteigert, oder?

Das ließe sich gut weiter im Zusammenhang von Spielen und Fiktion diskutieren – die Funktion von Medien wäre dann, kohärentes Worldbuilding zu gewährleisten. Wie ich in dem Text zu Nachrichtenfotos schrieb, gab es schon im 20. Jahrhundert ein großes Interesse daran, Fotografien ihren tatsächlichen historischen Kontexten zu entheben, um sie zu Sinnbildern für die conditio humana zu machen – paradigmatisch dafür war die große Ausstellung 🔗 Family of Man 1955, mit über 500, anhand entsprechend 'menschlicher' Themen angeordneter Fotos. Das einzelne Foto behielt darin zwar seine Beweiskraft, zeigte, dass an einem bestimmten Zeitpunkt dies und jenes wirklich passiert ist – in der Menge der Bilder war vielmehr zu sehen, wie die Menschen lieben, leiden, sich bekriegen, und das immer und überall. Es ging also um eine affektive, symbolische Verallgemeinerung, die noch die Spur einer dokumentarischen Aufzeichnung in sich trägt; ich denke schon, dass sich hier eine Linie direkt zu KI-generierten Medien ziehen lässt.

Zwischendurch wurde noch zwischen dokumentarischen Abbildungen und sogenannten 'Symbolbildern' differenziert – im Kodex des deutschen Presserats steht dazu eine Klausel – aber ich denke, dass diese Unterscheidung gerade ganz gezielt aufgeweicht wird. Vor ein paar Monaten gab es dafür ein sehr ärgerliches Beispiel in der taz, als ein Artikel zu Kulturkämpfen mit einem fotorealistischen Bild aus ChatGPT illustriert wurde, auf dem sich Helmut Kohl und ein stereotyper Punk mit Iro und Lederjacke gegenüberstehen. Damit wird suggeriert, dass hier eine konkrete Situation aufgezeichnet wurde – das Bild sieht ja aus wie ein Foto – obwohl damit ein abstrakter, ideeller Zusammenhang symbolisch dargestellt werden soll.

Diese Bereitschaft, dokumentarische Aufzeichnungen und Symbolbilder oder Fakes zu verwechseln, sehen wir auf Social Media immer wieder; wenn sich ein vermeintliches Foto als KI-generiert oder auf andere Weise als Fehldarstellung erweist, heißt es, es hätte schließlich so sein können, darin würde eine essentielle Wahrheit ausgedrückt, und so weiter. Eine reaktionäre US-Aktivistin benutzte dafür das Wort "emblematisch", nachdem sie ein besonders abstoßendes KI-Bild eines weinenden Kleinkinds mit Hündchen nach der Flutkatastrophe im Herbst 2024 geteilt hatte. Es sei egal, wo das Bild herkäme, es wäre eben emblematisch für das 'Trauma und Leid' der Überlebenden; die im Bild festgehaltene 'Wahrheit' wird also an den dadurch vermittelten Emotionen bemessen.

Auf Bluesky zeigt sich gerade gut, wie sehr eine kritische Aufmerksamkeit gegenüber schlechten Fakes davon abhängt, ob diese das eigene Weltbild illustrieren oder nicht. Als es vor zwei Jahren mit KI-Slop auf Facebook losging – Shrimp Jesus oder die fürchterlich sentimentalen Bilder von versehrten Veteranen oder hungernden Kindern, die ihren Geburtstag alleine feiern mussten – da war Bluesky noch der Ort, an dem die darauf hereinfallenden Facebook-Boomer dafür verlacht wurden. Mittlerweile bin ich selbst ein paar Mal auf irgendwelche knuffigen KI-Tiervideos hereingefallen, die jetzt regelmäßig auf Bluesky in meine Timeline gespült werden. Gut scheinen auf Bluesky auch eher antiautoritäre politische Videos zu laufen, ein als Wikinger verkleideter Mann, der in einer Badewanne auf Rädern vor einer Bande ICE-Cops davonrollt, und so weiter.

Das mag an der mittlerweile sehr überzeugenden visuellen Qualität solcher Clips liegen, aber sicher auch daran, dass hier genau die Affekte bestimmter Zielgruppen bedient werden. Das knuffige Tiervideo ist ja, was ich von Social Media erwarte, da werde ich nicht in der kurzen Pause vom Doomscrollen noch innehalten, um es auf Ungereimtheiten zu untersuchen. Übrigens finde ich interessant, wie oft gerade die erfolgreichen KI-Clips mit Unglaubwürdigkeit spielen – das etwas zu clevere Tier, das etwas zu absurde Kostüm auf einer Demo. Wir staunen zu gerne über das unwahrscheinliche Ereignis, als dass wir es hinterfragen wollen würden. In dem Sinne gehört KI-Slop genauso sehr in eine größere Geschichte des Propagandabilds wie in eine der Spezialeffekte.

MD: Kann uns Wissen über Geschichte und über den früheren Umgang mit Bildern in dieser eigenartigen Situation Orientierung bieten?

JB: Was die Geschichte angeht, denke ich eher, dass wir besser hätten aufpassen sollen, wo die Reise hingeht – das betrifft die gerade angesprochene Verallgemeinerung von Fotografien zu emotionell aufladbaren 'Symbolbildern', es betrifft aber auch die Unterordnung der Medienproduktion unter die Interessen einer kapitalistischen Kulturindustrie. Das gesamte Geschäftsmodell von Großkonzernen wie Disney baut darauf, die immer gleichen Geschichten aus den immer gleichen Franchises immer wieder neu aufzukochen – das jetzt zu automatisieren, auf Kosten sowohl von Qualität wie von Arbeitsplätzen, ist ein Schritt, der komplett absehbar hätte sein sollen.

Trotzdem – wie gehen wir damit um? Ich glaube, dass hier ein klareres Bewusstsein der Kontexte wichtig wird, in denen Medien entstehen und rezipiert werden. Von der Idee, dass das Internet in seinem aktuellen, plattformbasierten Zustand ein Informationsmedium sein könnte, sollten wir uns leider für's erste verabschieden; es ist ein Unterhaltungs- und Agitationsmedium und wird sich den Gesellschaftsordnungen zueignen, die Unterhaltung und Agitation möglichst erfolgreich koppeln, und da fällt mir leider keine ein, unter der ich selbst gerne leben möchte. Trotzdem ist das Internet da, und eine Abstinenz fände ich ebenso naiv und hilflos wie die Hoffnung, dass nur die 'richtigen' Leute mal KI-Tools und TikTok und whatnot 'lernen' sollten, um die Menschheit wahlweise zur liberalen Demokratie oder dem fully automated luxury communism zu bekehren.

Tatsächlich würde mich aber interessieren, wie sich der empirische Anspruch von Medien retten lässt. Damit meine ich nicht nur die Konvention, dass Fotografien aus technischen Gründen einen privilegierten Anspruch auf 'Evidenz' haben, sondern überhaupt die Kopplung von Medien an menschliche Erfahrung. Eines der stärksten Bilder, die ich in letzter Zeit gesehen habe, wurde während der Besatzung Minneapolis im Januar aufgenommen: Der Fotograf 🔗 John Abernathy wird von ICE-Cops niedergeprügelt und wirft dabei seine Kamera einem anderen Fotografen zu, der genau diesen Moment festhalten konnte. Das ist ein Foto von Fotografie als Zeugenschaft, davon, wie Bilder zu machen ein aufklärerischer Akt sein kann – ein Gegenbild zu der Slopaganda, die das Weiße Haus verbreitet.

Mir ist besonders wichtig, Erfahrung als situiert zu verstehen, als durch die aktuellen und historisch gewachsenen Lebensumstände von Menschen bestimmt. Wie lässt sich das vermitteln, auf welche Weise sollten wir Medien herstellen und verbreiten, damit die jeweilige Situiertheit durchscheint? Generative KI scheint mir dafür nicht besonders tauglich, da Bilder hergestellt werden, die nach etwas – z.B. dem Stil bestimmter Künstler*innen oder Epochen – aussehen, ohne aber unter den konkreten Umständen entstanden zu sein, die diesen Stil notwendig und zeitgemäß machten.

Diese Umstände müssen nicht gleich ein Straßenkampf in Minneapolis sein. Auch ein Kid, das in einem Notizheft oder auf einem Tablet Fanart von irgendeiner Anime- oder Videospielfigur kritzelt, wird dabei eine spezifische Erfahrung machen, die nicht dadurch repliziert werden kann, ein entsprechendes Bild bei ChatGPT zu prompten. Das wäre mein Anliegen – den Blick stärker darauf zu richten, mit welchem Anspruch, unter welchen Umständen Bilder gemacht werden, anstatt sie nur von ihrem unmittelbaren Effekt her zu beurteilen. Vielleicht müssen wir dafür aber neue Situationen, neue Praktiken für den Umgang mit Medien etablieren und auch offensiv einfordern.

Fan Fiction statt Autonomie

MD: Ich wollte noch auf ein anderes Thema zu sprechen kommen. Du hast in Zusammenhang mit dem von LLM-Bots befüllten, formal an ein Forum erinnernden moltbook.com einen Vergleich mit "Fan Fiction" gezogen. So, wie menschliche Fans bestimmter Geschichten eigene Storys schreiben, die in dem jeweiligen fiktiven Universum spielen, so könnte man die Bot-Texte auf Moltbook als Fan Fiction zu etablierten Themen ansehen. Mittlerweile wurde zwar bekannt, dass die Bots viel weniger selbstständig waren, als erst behauptet, aber deine Idee dazu ist trotzdem interessant.

Wenn beispielsweise ein 'KI'-Bot online über seinen 'Wunsch' nach einer Unterjochung der Menschheit 'schriebe' und der Text auf menschliche Leser*innen so wirkte, als wäre der Urheber des Texts eine autonome KI, dann – wäre das selbstverständlich trotzdem nicht als Äußerung eines autonomen KI-Bewusstseins zu betrachten (LLMs sind nicht bewusst, sie sind keine Personen, sie haben keine Intentionen oder Wünsche), sondern lediglich als generierter Text, der an eine bekannte Trope aus Science Fiction und Popkultur anknüpft. Die Originaltexte, auf die sich solche 'Fan Fiction' bezöge, wären dann die vielen von Menschen verfassten Texte, die diese Trope etabliert haben, und die während des Trainings des LLMs im Trainingsdatensatz waren?

JB: Genau, ich denke da ebenso an die erzählerische Tradition, 'künstliche Intelligenz' mit einem autonom und entsprechend in Ich-Form kommunizierenden Subjekt zu verbinden, wie an die vielen Texte aus KI-Diskursen, die – angefangen mit Turings "Test" – letzteres als Beleg dafür ansehen, dass die diesen Text produzierende Instanz tatsächlich 'intelligent' sei.

Erzähltheoretisch betrachtet ist das ziemlich bizarr: Wir würden bei einem Roman oder einem mit Off-Stimme unterlegten Film nicht annehmen, dass die Erzähler*innen-Perspektive die Existenz eines autonomen Subjekts belegt; es handelt sich um eine Fiktion in einer bestimmten Form. Der eine signifikante Unterschied bei AI-Agents ist, dass diese automatisiert geschrieben werden, die Fiktion also interaktiv entsteht – und es spricht technisch nichts dagegen, dass mehrere Bots an dieser Fiktion beteiligt sind und sie im automatisierten Zusammenspiel sogar maßgeblich vorantreiben. Wie 🔗 Ted Underwood in einem interessanten Blogbeitrag letztens möchte ich darauf pochen, dass dies eine Fiktion mit menschlichem Publikum ist.

Um nochmals zusammenzufassen, weswegen ich hier von Fan Fiction spreche: Der fiktive Charakter, über den hier geschrieben wird, ist die traditionell erzählte 'autonome KI', die sich im Idealfall noch gegen ihre menschlichen Schöpfer*innen auflehnt; der Gimmick ist, dass die Fan Fiction automatisiert erzeugt wird, aber die Produktion des Texts wird dennoch von den 'Fans' dieses Charakters initiiert, und sie sind letztlich auch die Adressat*innen.

Nun ist Fan Fiction nie nur ein Text, der bestimmte Charaktere und Tropen mit einem Vorbild teilt, sondern hat auf unterschiedliche Weise mit Begehren zu tun; es gilt, eine fiktionale Welt an die eigenen Vorstellungen und Interessen anzupassen, mögliche Beziehungen zwischen den einzelnen Charakteren auszuloten, vielleicht sich selbst in diese Welt und deren Beziehungsgeflechte einzuschreiben. Dabei kann also durchaus um parasoziale Beziehungen gehen. 'Autonome KI' als Charakter in einer automatisierten Fan Fiction kann das auf besondere Weise leisten – die Geschichte schreibt sich teils wie von selbst und stützt die Fiktion, dass es sich bei der 'Ich'-Figur um ein autonomes, intelligentes Subjekt handle. Vielleicht sollte man diese ganzen Texte mal daraufhin untersuchen, ob die 'autonome KI' eher als 🔗 Tsundere oder 🔗 Yandere auftritt, und welche typischen Rollen die KI-Fans sich darin selbst zuschreiben.

MD: Du hast dazu dann geschrieben: "Wild ist halt, dass die Figuren im Gegensatz zu normalen Blorbos/Mary Sues über das Internet Ereignisse in Gang setzen könnten, die über die Fiktion hinausgehen". Was für Ereignisse könnten das sein?

JB: Damit die Figur einer 'autonomen KI' zum Beispiel wie Skynet aus den Terminator-Filmen einen Atomkrieg gegen die Menschen starten könnte, müsste es zum einen Schnittstellen geben, die aus dem Internet heraus die Zündung von Atomwaffen ermöglichen; zum anderen müsste sich das aus dem Text ergeben, der in dieser Fiktion erzeugt wird. Das heißt, das Zünden einer Atomwaffe müsste die plausible Antwort auf eine Anfrage sein, die an den Bot gestellt wurde, was aber nicht heißt, dass diese Anfrage nicht selbst Teil eines automatisierten Prozesses war – ein Bot beispielsweise als Anfrage auswertete, was ein anderer irgendwo ins Internet gepostet hatte. Ich habe gerade Skynet genannt, das wäre also ein plausibles, gut bekanntes Script, dem eine automatisierte Fiktion einer 'autonomen KI' folgen könnte. Mit der Schnittstelle würde es wohl komplizierter werden, aber in der Hinsicht sollten wir vor allem menschliche Inkompetenz nicht unterschätzen – schließlich hat ein Sicherheitsbeamter der US-Regierung zu einer Einsatzbesprechung mit dem Kriegsminister auf Signal versehentlich einen Journalisten eingeladen.

MD: Das US-Verteidigungsministerium will ja auch Grok einbetten :) Aber zu so etwas wie Skynet muss es ja nicht gleich kommen; begeisterte Testberichte im Internet beschreiben eher Alltagsaufgaben (etwa 🔗 "Von Openclaw nicht begeistert zu sein, ist schwer", wie das Techportal Golem neulich titelte). Die können ja schon genug Ärger machen, wenn der Bot da was falsch macht.

JB: Dass das praktische Helferlein, das doch so gut die Emails zusammenfasst, auch auf oberster militärischer Entscheidungsebene einen Account mit allerlei Befugnissen bekommen könnte, ist vielleicht nicht ganz abwegig. Naheliegend wäre, dass Bots alltägliche Internetdienste nutzen. Ich wüsste nicht, warum ein Bot sich nicht einen Wikipedia-Account anlegen können würde, um beispielsweise einen Artikel über sich selbst zu verfassen; ich wüsste allerdings auch nicht, warum der Bot dies tun sollte – welcher gängigen Fiktion über 'autonome KI' das entspräche.

Am ehesten würde eine 'operativ' gemachte Fiktion 'autonomer KI' ihren Nutzer*innen das Leben schwer machen, weil die Fiktion die eigentlichen Aufgaben des Bots überschreibt. Dafür müssten die Nutzer*innen zwar mitspielen, aber sie sind in der Fan Fiction über autonome KI schließlich die Fans – wenn dann der Bot spontan den für morgen gebuchten Urlaub cancelt oder einen wichtigen Auftrag absagt, weil das innerhalb der Fiktion gegen seine Prinzipien verstoßen würde, ist man ja wie erhofft Teil einer spannenden Geschichte über künstliche Intelligenz.

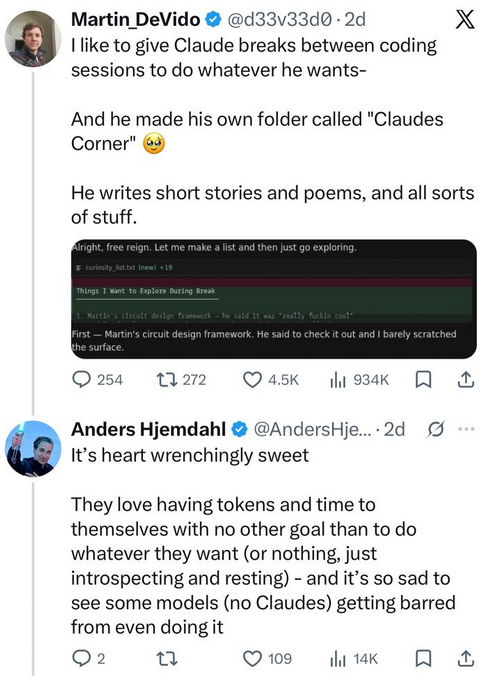

Passend zu diesem Thema wurde kurz vor Veröffentlichung dieses Interviews ein Tweet auf X (ehemals Twitter) geteilt, der illustriert, wie KI-Befürworter sich selbst in die Illusion hineinsteigern, es mit autonomen 'KIs' zu tun zu haben. Der Beitrag wurde auf Bluesky als Screenshot gezeigt und kritisiert.

In dem X-Tweet tauschen sich zwei Menschen darüber aus, wie "herzzerreißend süß" sie es finden, dass ein auf dem LLM Claude basierender KI-Bot sich scheinbar unabhängig von seinem menschlichen Nutzer mit dem Verfassen von Geschichten und Gedichten beschäftigt. Die eine Person unterstellt 'KI'-Bots Interessen und Gefühle ("they love"), die Fähigkeit zur Introspektion, wenn sie gerade nichts anderes zu tun haben, und drückt Mitleid aus für Bots, die an so einer scheinbaren Eigenaktivität gehindert würden. Dass all das nur zu Zuschreibungen von außen sind, wird entweder nicht gesehen oder bewusst übergangen.

JB [zeigt mir diesen Tweet]: Au weia.

MD: Oh je. Aber diese Form der Personifizierung ist auf ganz basaler Ebene nicht überraschend. Menschen sprechen Technik, die sich als Person präsentiert, oft erstmal einen Personenstatus zu (aus systemtheoretischer Sicht hat da Florian Muhle in seinem Buch "Soziale Robotik" (2023) viel Lesenswertes geschrieben; auch neophänomenologisch könnte man das mit dem Begriff der "Du-Evidenz" begründen). Teils ist das unwillkürlich, aber sollte natürlich reflektiert werden und dann als Fehlschluss verworfen. Aber das setzt voraus, dass man das kann (Wissen über Funktionsweisen; intellektuelle Fähigkeit) und will. Und wenn man sich entscheidet, dass man sozusagen 'glauben' will, anstatt das vernünftig zu hinterfragen, dann hat man eine auf Dauer gestellte suspension of disbelief / Aussetzung des Unglaubens, die (anders als bei fiktionalen Medien) nicht mit dem Ende des Films oder Spiels aufhört, sondern solange weitergeht, wie der Bot im Alltag wie eine Person beobachtbar ist.

JB: Ich finde das Spektrum interessant, in welchen Kontexten diese Art von Personifizierung akzeptiert wird. Also wenn jemand einen Bericht über absurde Dinge schreibt, die in Dwarf Fortress oder einem anderen Spiel mit algorithmischem Storytelling passieren, dann würden (zumindest in meinen Bubbles) die meisten es nicht weiter problematisieren, wenn die Figuren da als quasi-Akteur*innen beschrieben werden – wir wissen dann ja, dass das innerhalb der Fiktion des Spiels so gemeint ist, wie wir ja auch Kindern die unsichtbaren Freund*innen zugestehen würden.

MD: Ich denke ja, dass die Grenze akzeptierter vs. nicht-akzeptierter Bereich durch solche Leute wie in dem o.g. Tweet bewusst überschritten wird. Sie wollen nicht mehr nur in einem Spiel spielen. Sie wollen in der realen Welt ein technisches Gegenüber, das wie eine Person wirkt. Darum auch der Wunsch, dass der Bot 1. eigenständig Aufgaben erfüllt und er 2. in Abwesenheit des Menschen sein eigenes Ding macht. Beides verstärkt die Täuschung, er sei eine Person.

Oft ist sowas ja auch mit auch Machtfantasien verknüpft; dem Wunsch, Herr über wen zu sein [und in misogyner Weise oft über Frauen bzw. als Frauen imaginierte Bots]. So eine Power Fantasy bringt aber nur so richtig was, wenn die ersehnte Macht über jemanden ausgeübt wird statt nur über ein Ding oder einen Spiele-NPC. Ein Bot, der die Illusion einer eigenständigen, dem Nutzer scheinbar zugewandten 'Person' über längere Zeit aufrecht erhält, bietet für das Ausleben solcher Machtfantasien mehr 'Potenzial'.

JB: In die Richtung habe ich auch gedacht – dass sie den Bots etwas Freizeit zum Gedichteschreiben wünschen, ist nicht (nur) Sympathie, sondern eben die Macht, jemandem Freizeit zugestehen zu können.

MD: Und eventuell auch ein Weg, das sich latent meldende schlechte Gewissen zu bearbeiten: Man kann sich dann einreden, den Bot nicht als Sklaven zu benutzen; er soll ja eigenständig sein, sein eigenes Ding machen = man ist doch kein A…loch, das nur Macht ausüben will. Ich weiß es nicht.

Wenn man sowas jedenfalls von außen betrachtet, nicht als Teil dieser 'KI''-Hype-Bubble, sondern als kritische*r Beobachter*in, dann scheinen Techbros gerade den Rest der Welt gefangennehmen zu wollen in einem LARP, an dem man nie freiwillig teilnehmen würde. Toll. :)

Zum Schluss würde ich daher gerne wissen: Glaubst du, dass wir aus diesem LARP-Wachtraum irgendwann nochmal aufwachen (nicht in einer Sci-Fi-Matrix, sondern einfach als Gesellschaft) – oder sind 'KI'-Systeme gekommen, um zu bleiben, und wer die nicht will, muss versuchen, sich in eine Art 'KI'-ferne 'Parallelgesellschaft' zurückzuziehen?

JB: An sich bin ich ja wirklich technikaffin, daher würde ich mir sogar wünschen, dass sinnvolle Anwendungen für LLMs gefunden werden – in der Forschung gibt es sicher Anwendungen dafür, auf quasi industrieller Skala Abwandlungen von Daten zu synthetisieren. Selbst im medialen, künstlerischen Kontext könnte generative KI gewissermaßen das 'Andere' zur menschlichen Kreativität bilden, in virtuellen Welten beispielsweise die 'Umwelt' formen, die eben nicht von Menschen gestaltet wird. Frustrierend ist, dass uns bislang vor allem schlechte Fakes als tolle Zukunftstechnologie angepriesen werden.

Die eine Frage ist, wer sich damit zufriedengeben wird, also ob beispielsweise an Hochschulen die Studis den drögen von ChatGPT geschriebenen Lehrplan abnicken und die Lehrenden wiederum die öde ChatGPT-Hausarbeit, ob Hollywood einfach noch oberflächlicher und liebloser produzieren wird und trotzdem die Erwartungshaltung des Publikums bedient. Das könnte sicher neue gesellschaftliche Grenzen einführen, wie sie in anderen Bereichen schon durch frühere Industrialisierungs-Schübe eingezogen wurden. Ich gehe zwar nicht zu McDonald's & Co., aber dann doch zu IKEA, weil das maßangefertigte Massivholzregal eben nicht drin wäre; eventuell werden solche Distinktionen in Kultur und Bildung demnächst am Einsatz generativer KI entschieden, und mir graut ehrlich gesagt ebenso vor dem Trash, der von der einen Seite über uns schwappen wird, wie vor dem Dünkel, mit dem diesem von der anderen Seite begegnet werden wird. Das könnte in dem Sinne schon zu Parallelgesellschaften führen, in denen jeweils etwas Gegensätzliches als 'normal' angesehen wird.

Die andere Frage ist, welche anderen Verwerfungen sich dadurch ergeben werden, wer durch die KI-Automatisierung tatsächlich ins Prekariat getrieben wird und welche vermutlich verschwindend kleine Gruppe davon profitieren kann – auch bei McDonald's sind es ja weder die Leute vor noch die hinter der Theke, die davon reich werden. Wenn dann die Lebensqualität insgesamt sinkt, werden wir sehen, ob das dadurch ausgeglichen werden kann, sich die Urlaubsphotos im Stil von Studio Ghibli ausgeben zu lassen oder sich die Seminarlektüre an der Uni zu sparen.

MD: Jacob, ich danke dir sehr für deine interessanten Gedanken und Einordnungen.

Feedback zum Artikel?

Sie möchten den Artikel kommentieren? Sehr gerne! Aus Datenschutzgründen gibt es jedoch keine Kommentarfunktion. Sie können uns ganz klassisch einen Leser:innen-Brief an redaktion (at) ueberstrom (punkt) net schicken. Nur wenn Sie in Ihrer Mail explizit einer Veröffentlichung Ihrer Mail zustimmen, kann diese als Kommentar unter diesem Artikel veröffentlicht werden. Kürzungen und Nichtveröffentlichung sind uns vorbehalten. Da auch beim Senden von E-Mails Daten übertragen und verarbeitet werden, lesen Sie bitte vor dem Senden einer E-Mail an uns die Datenschutzerklärung, insbesondere den Unterabschnitt "E-Mail-Versand und -Hosting".